原创 全球首次实现!上海交大推出全光生成式AI芯片LightGen,研究登上Science

随着深度神经网络和大规模生成模型快速演进带来超高算力和能耗需求,传统芯片架构的性能增长速度已出现严重缺口,光计算等新型架构受到广泛关注。

如今,上海交大集成电路学院助理教授陈一彤团队在这一领域实现了新的突破——全光生成式 AI 芯片 LightGen。

据介绍,LightGen 首次将光子计算拓展至大模型语义媒体生成领域,在多项生成任务中实现了超高能效与速度,为光子计算在 AI 领域的应用提供了新的路径。相关研究论文也已发表在权威科学期刊 Science 上。

论文链接:https://www.science.org/doi/10.1126/science.adv7434

LightGen 可完整实现“输入-理解-语义操控-生成”的闭环,完成高分辨率(≥512×512)图像语义生成、3D 生成(NeRF)、高清视频生成及语义调控,同时支持去噪、局部与全局特征迁移等多项大规模生成式任务。

“LightGen 为新一代光计算芯片助力前沿 AI 开辟了新路径,也为探索更高速、更高能效的生成式智能计算提供了新的研究方向。”陈一彤说。

LightGen是个啥?有啥用?

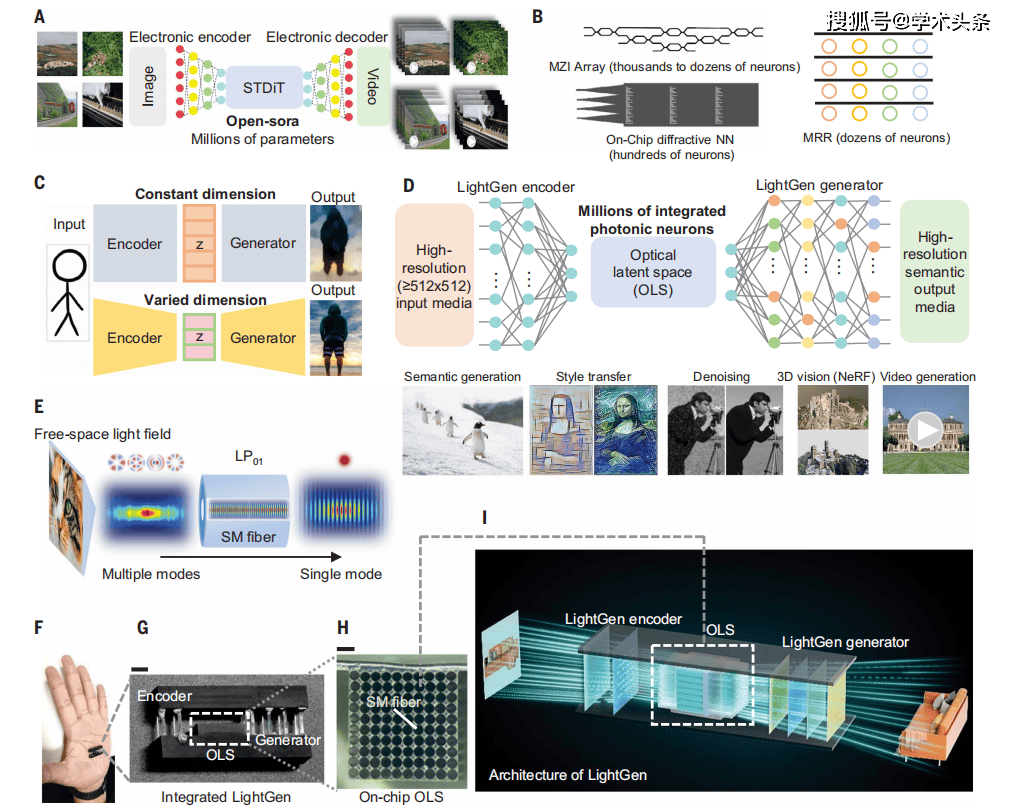

据论文描述,LightGen 的整体架构由光子编码器、光学潜在空间(OLS)和光子生成器构成,实现了端到端的全光生成流程。

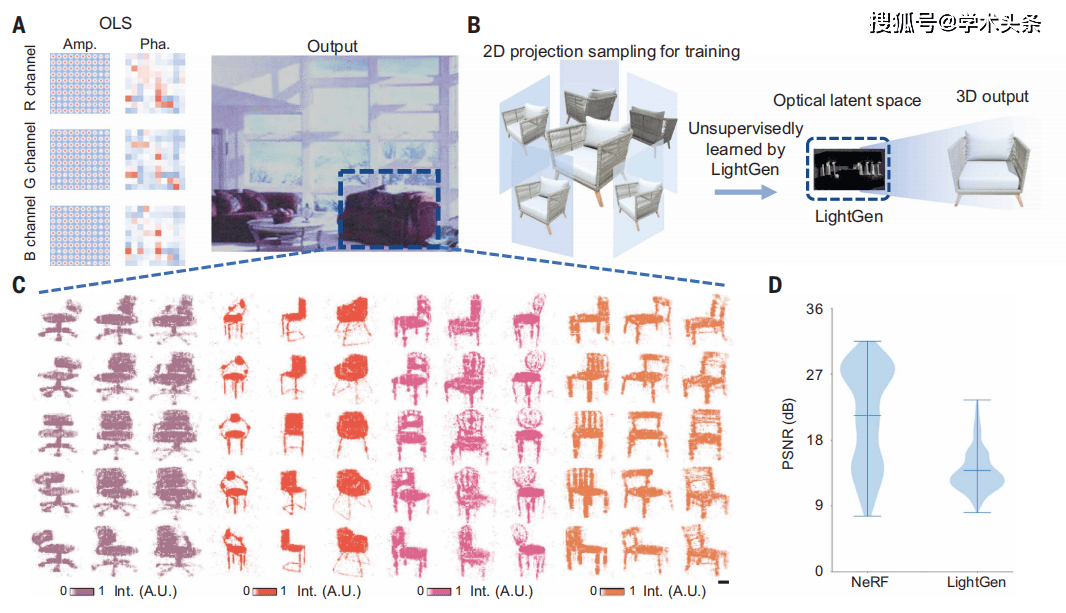

其中,光子编码器由集成衍射超表面组成,用于将高维图像压缩为低维特征,并通过光场耦合进入单模光纤阵列完成子采样。由光纤阵列构建的 OLS 同时对振幅和相位进行编码,使特征在低维空间呈现可建模的概率分布,并引入生成任务所需的随机波动性。随后,光子生成器从 OLS 中读取变化特征并输出语义结果,实现多类任务的处理。

此外,LightGen 引入无监督训练算法 BOGT,通过目标潜空间分布约束模型特征表示,实现无需标签的生成训练。同时,它支持多生成器切换结构,可在不同生成路径间完成重构与生成,提高模型灵活性。

图|LightGen 架构示意图。

语义图像生成、去噪与风格迁移

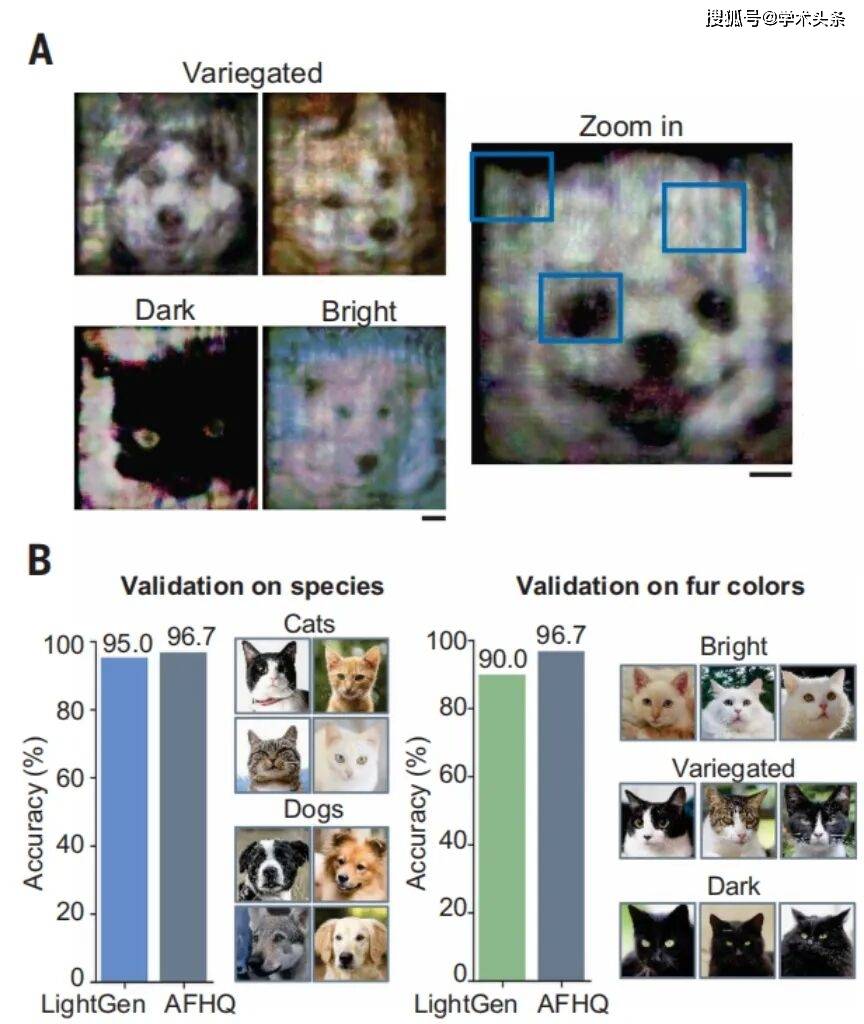

LightGen 能高效处理高分辨率语义图像生成、去噪与风格迁移任务。它可生成 512×512 像素的多类别图像,细节如毛发纹理和眼部反光清晰可见,嵌入特征与真实数据高度一致,生成质量接近 Stable Diffusion。

图|LightGen 在语义生成任务上的实验结果。

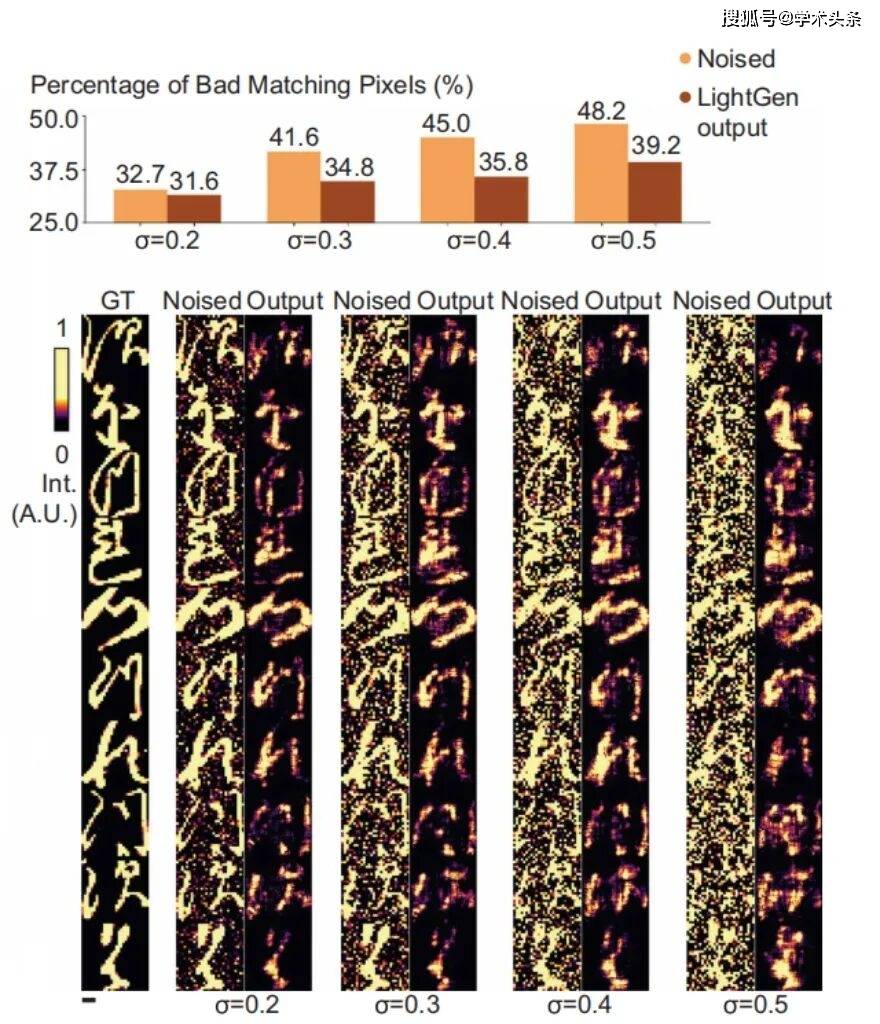

在语义去噪任务中,LightGen 利用自由空间模式与单模光纤阵列的高信息容量,即使在极高坏匹配像素比例下,也能有效降低噪音并显著提升图像可读性,最高相对降幅达 20.4%。

图|LightGen 在语义去噪任务上的实验结果。

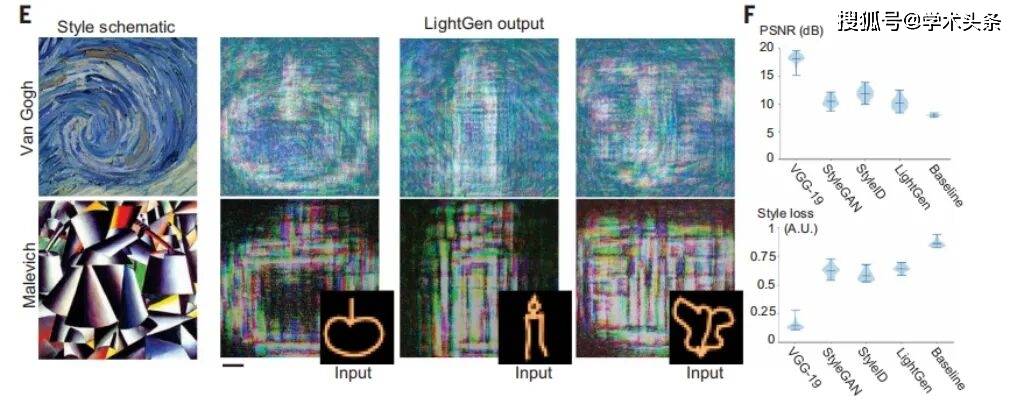

在风格迁移中,它无需切分图像即可处理整幅高分辨率输入,实现印象派、金属风等多种风格转换,同时保持物体类别和全局结构完整,性能接近先进电子网络。

图|LightGen在风格迁移任务上的实验结果。

相比传统光子计算芯片需切分补丁处理图像,LightGen 的大规模 3D 集成结构支持整幅图像生成,能保持连续结构与全局特征,如手写字体向印刷字体的连续转换,展现出显著优势。这表明其 3D 集成与大规模输入输出结构不仅是尺寸扩大,更对语义生成能力产生了质的提升。

3D 生成与语义操控

LightGen 能基于 2D 投影训练生成包含多物体结构的室内场景图像与视频,并以无监督方式学习到三维几何与视觉结构,其生成质量与 NeRF 接近。通过操控 OLS,LightGen 可进行多视角生成与风格控制,例如生成不同类型、结构细节各异的椅子,并成功再现形状、支柱粗细与曲线纹理等特征。

LightGen 的 OLS 表征具有物理可解释性,能够针对局部语义进行操控, 还可以生成连续一致的 3D 视频序列,体现出对全局结构和动态特征的稳定控制。

图|LightGen 生成的采样图像示例。

系统速度、能效与计算密度

LightGen 在生成任务上的三项核心指标,即系统速度、能效和计算密度,都远超现有电子芯片。

即便在非常保守、缩小运算量的评估条件下,LightGen 依旧实现了 3.57×10^4 TOPS 的计算速度、6.64×10^2 TOPS/W 的能效,以及 2.62×10^2 TOPS/mm² 的计算密度,整体性能比英伟达 A100 高出两个数量级以上。这意味着 LightGen 在同等时间内能处理更多数据,在相同能耗下能完成更多计算,芯片面积更小但算力更高。

未来展望

LightGen 通过三维封装解决了光子神经元的集成规模问题;通过提出 OLS 实现了光速维度转换;通过提出 BOGT 训练算法,摆脱了对预定义真实标签的依赖,转向对底层概率分布建模。

未来,LightGen 可通过增加超表面像素与层数、提升 OLS 维度或采用分块生成策略进一步扩展处理分辨率。尽管超表面规模扩展会提升整体计算速度,但也需要更高输入能量以维持计算精度。